目录

选数据库这件事,很多人第一反应是MySQL、PostgreSQL,但其实很多场景下,SQLite才是真正的"刚刚好"。轻量、零配置、文件即数据库——听起来简单,但连接方式选错了,照样踩得一脸懵。今天咱们就把Python连接SQLite的5种主流方式摆出来,逐个拆解,看看哪种最适合你手头的项目。

🗂️ 先说说为什么SQLite值得认真对待

很多开发者把SQLite当"玩具数据库",觉得它只配做原型验证。这个认知,说实话,有点偏。

SQLite是全球部署量最大的数据库引擎,没有之一。Android系统内置它,iOS用它存联系人,Chrome用它管书签,微信本地消息也是它。这玩意儿的稳定性和成熟度,完全不输那些需要单独部署服务的"正经数据库"。

在Windows开发环境下,SQLite还有一个特别实在的优势:不需要安装任何服务,不需要配置端口,不需要管理用户权限。一个.db文件,就是你的整个数据库。对于桌面应用、数据分析脚本、自动化工具、本地缓存系统来说,这种零运维成本简直是福音。

好,背景铺完了,进正题。

🔌 方式一:sqlite3 标准库——最原始,也最可靠

Python内置的sqlite3模块,是接触SQLite的第一道门。不需要pip install任何东西,开箱即用。

pythonimport sqlite3

# 连接数据库(文件不存在会自动创建)

conn = sqlite3.connect('myapp.db')

cursor = conn.cursor()

# 建表

cursor.execute('''

CREATE TABLE IF NOT EXISTS users (

id INTEGER PRIMARY KEY AUTOINCREMENT,

name TEXT NOT NULL,

age INTEGER,

created_at TIMESTAMP DEFAULT CURRENT_TIMESTAMP

)

''')

# 插入数据(参数化查询,防SQL注入)

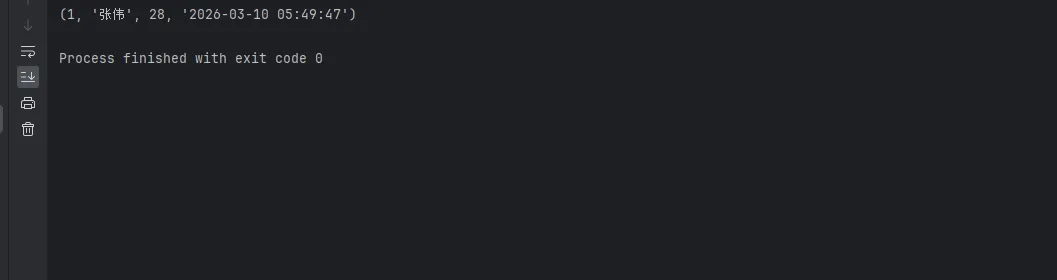

cursor.execute("INSERT INTO users (name, age) VALUES (?, ?)", ("张伟", 28))

conn.commit()

# 查询

cursor.execute("SELECT * FROM users WHERE age > ?", (25,))

rows = cursor.fetchall()

for row in rows:

print(row)

conn.close()

这种写法的好处是完全透明——每一条SQL你都亲手写,执行逻辑一目了然,调试起来没有任何黑盒。性能上也是5种方式里最直接的,没有任何中间层开销。

但问题也很明显。连接管理容易忘记关闭,一旦程序异常退出,文件锁可能没释放。更推荐的写法是用上下文管理器:

pythonimport sqlite3

with sqlite3.connect('myapp.db') as conn:

cursor = conn.cursor()

cursor.execute("SELECT * FROM users")

print(cursor.fetchall())

# 出了with块,连接自动关闭,异常也能正确处理

适用场景:脚本工具、数据处理、对性能极度敏感的批量操作。不适合大型项目——随着表增多,裸SQL会变成维护噩梦。

🏗️ 方式二:SQLAlchemy Core——SQL的"精装修"版

SQLAlchemy是Python数据库生态里的老大哥。它分两层:Core层和ORM层。先说Core,这一层本质上还是写SQL,但用Python对象来构建查询,而不是拼字符串。

pythonpip install sqlalchemy

pythonfrom sqlalchemy import create_engine, Table, Column, Integer, String, MetaData, select

engine = create_engine('sqlite:///myapp.db', echo=False)

metadata = MetaData()

# 定义表结构

users = Table('users', metadata,

Column('id', Integer, primary_key=True),

Column('name', String(50), nullable=False),

Column('age', Integer)

)

metadata.create_all(engine)

# 插入

with engine.connect() as conn:

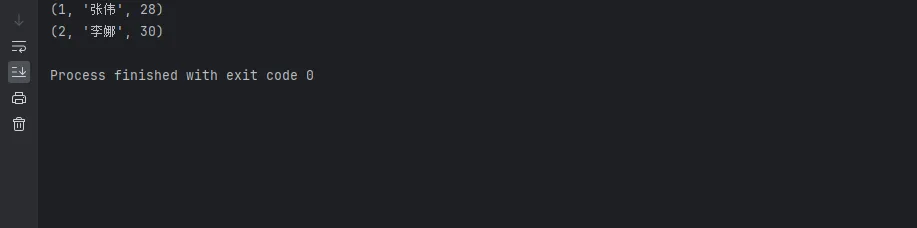

conn.execute(users.insert().values(name="李娜", age=30))

conn.commit()

# 查询

with engine.connect() as conn:

stmt = select(users).where(users.c.age > 25)

result = conn.execute(stmt)

for row in result:

print(row)

Core层的优势在于数据库无关性。今天用SQLite,明天要迁移到PostgreSQL,只需要改一行连接字符串,其余代码几乎不动。这对于那种"先本地跑,后来要上云"的项目,价值非常大。

性能方面,Core层的额外开销非常小,基本可以忽略不计。但学习曲线比裸sqlite3陡,初期需要适应它的查询构建语法。

适用场景:中型项目、需要数据库迁移灵活性、团队协作开发。

🎯 方式三:SQLAlchemy ORM——让表变成类

ORM(对象关系映射)这个概念,爱它的人觉得它是神器,烦它的人觉得它是枷锁。我个人的态度是:用对地方,真香;用错地方,真烦。

pythonfrom sqlalchemy import create_engine, Column, Integer, String

from sqlalchemy.orm import DeclarativeBase, Session

engine = create_engine('sqlite:///myapp.db')

class Base(DeclarativeBase):

pass

class User(Base):

__tablename__ = 'users'

id = Column(Integer, primary_key=True, autoincrement=True)

name = Column(String(50), nullable=False)

age = Column(Integer)

def __repr__(self):

return f"<User(name={self.name}, age={self.age})>"

Base.metadata.create_all(engine)

# 插入

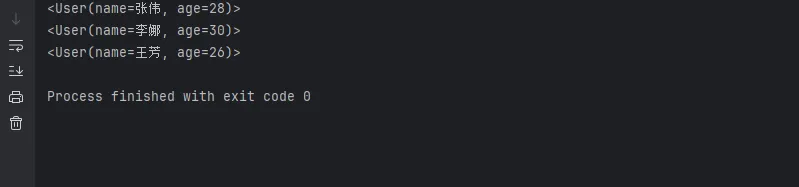

with Session(engine) as session:

new_user = User(name="王芳", age=26)

session.add(new_user)

session.commit()

# 查询

with Session(engine) as session:

users = session.query(User).filter(User.age > 25).all()

for user in users:

print(user)

ORM最大的好处是业务逻辑和数据模型高度融合。User这个类,既是数据库表的映射,也是业务对象,可以直接在上面加方法、加属性。代码可读性和可维护性,在复杂业务场景下,比裸SQL高出一个档次。

踩坑预警:ORM有个经典的N+1查询问题。比如你查了100个用户,然后在循环里访问每个用户的关联订单,它会触发100次额外查询。解决方案是用joinedload或selectinload预加载关联数据——这个坑,几乎每个ORM新手都会踩一次。

适用场景:业务逻辑复杂、数据模型有大量关联关系的应用,比如Web后端、桌面管理系统。

⚡ 方式四:dataset——懒人福音,动态表结构

dataset是个相对小众但极其好用的库。它的设计哲学是:操作数据库应该像操作Python字典一样简单。

pythonpip install dataset

pythonimport dataset

# 连接,表不存在会自动创建

db = dataset.connect('sqlite:///myapp.db')

# 直接插入,列不存在会自动添加——这是它最骚的地方

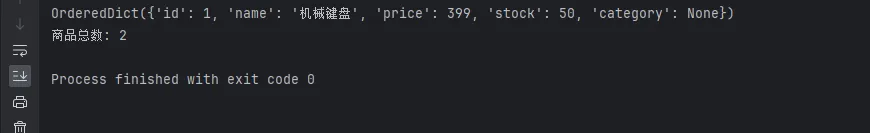

table = db['products']

table.insert({'name': '机械键盘', 'price': 399, 'stock': 50})

table.insert({'name': '鼠标垫', 'price': 29, 'category': '配件'}) # 多了category列,自动扩展

# 查询

for product in table.find(price={'gt': 30}):

print(product)

# 更新

table.update({'name': '机械键盘', 'price': 359}, ['name'])

# 统计

print(f"商品总数: {table.count()}")

注意到没有——第二次插入多了一个category字段,dataset会自动给表加上这一列,不需要提前ALTER TABLE。这种动态schema的特性,在快速原型阶段简直是神器。

但这也是它的软肋。Schema不固定,数据一致性全靠开发者自律,在团队协作或者生产环境里,这种灵活性反而是隐患。另外它的性能比直接用sqlite3慢一些,批量操作时差距会比较明显。

适用场景:个人工具、数据采集脚本、快速原型验证、不想写建表语句的场合。

🔬 方式五:pandas + SQLite——数据分析的黄金组合

如果你的主要工作是数据处理和分析,而不是业务逻辑开发,那pandas直接对接SQLite的方式,效率高到让人上瘾。

pythonpip install pandas

pythonimport pandas as pd

import sqlite3

conn = sqlite3.connect('sales.db')

# 从CSV导入数据到SQLite,一行搞定

df = pd.read_csv('sales_data.csv')

df.to_sql('sales', conn, if_exists='replace', index=False)

# 用SQL查询,结果直接是DataFrame

df_result = pd.read_sql_query('''

SELECT

product_name,

SUM(quantity) as total_qty,

ROUND(AVG(price), 2) as avg_price,

SUM(quantity * price) as revenue

FROM sales

WHERE sale_date >= '2025-01-01'

GROUP BY product_name

ORDER BY revenue DESC

LIMIT 10

''', conn)

print(df_result)

# 直接出图

import matplotlib.pyplot as plt

df_result.plot(x='product_name', y='revenue', kind='bar', figsize=(10, 6))

plt.tight_layout()

plt.savefig('revenue_report.png', dpi=150)

conn.close()

read_sql_query返回的直接是DataFrame,后续的数据清洗、统计、可视化,全部在pandas生态里完成,几乎不需要写任何转换代码。我在做销售数据分析的时候,这套组合拳用得非常顺手——把原始数据存进SQLite,用SQL做聚合,用pandas做进一步分析,整个流程行云流水。

这种方式的局限是:它不适合做增删改操作密集的业务系统,to_sql写入大量数据时内存占用也需要注意,超大文件建议分批写入。

适用场景:数据分析、报表生成、ETL脚本、Jupyter Notebook工作流。

📊 五种方式横向对比

| 维度 | sqlite3 | SQLAlchemy Core | SQLAlchemy ORM | dataset | pandas |

|---|---|---|---|---|---|

| 上手难度 | ⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐ | ⭐⭐ |

| 性能 | 最高 | 高 | 中等 | 中等 | 批量优秀 |

| 代码可维护性 | 低 | 中 | 高 | 低 | 中 |

| 数据库可迁移性 | 差 | 优秀 | 优秀 | 中 | 中 |

| 适合场景 | 脚本/工具 | 中型项目 | 复杂业务 | 快速原型 | 数据分析 |

🧭 怎么选?一个决策框架

选哪种方式,核心看三个维度:项目规模、团队协作需求、主要操作类型。

如果是个人脚本或者一次性数据处理任务,sqlite3或dataset直接上,别过度设计。如果是要长期维护的业务系统,SQLAlchemy ORM是更负责任的选择,前期多花点时间建模,后期维护成本会低很多。如果主要工作是数据分析,pandas + sqlite3的组合基本上可以覆盖90%的需求。

有一点值得特别说一下:这5种方式并不互斥。在同一个项目里,完全可以用ORM处理业务逻辑,同时用pandas做数据导出和报表,底层都是同一个SQLite文件。组合使用,往往比单一方式更灵活。

数据库连接方式的选择,表面上是技术问题,实质上是对项目生命周期的判断。选对了,代码越写越顺;选错了,越维护越痛苦。希望今天这篇对比,能帮你在下次动手之前,多想一秒钟。

相关标签:#Python开发 #SQLite #数据库 #SQLAlchemy #数据分析

本文作者:技术老小子

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!