你是否经常遇到这样的困扰:写了一大堆文件操作代码,结果忘记关闭文件,导致程序占用资源?或者在处理数据库连接时,异常发生后连接没有正确释放?作为Python开发者,这些问题在日常开发中屡见不鲜。

今天我们就来深入探讨Python上下文管理器(with语句),它能帮你彻底解决资源管理的烦恼。无论你是刚入门的新手,还是有经验的开发者,掌握上下文管理器都能让你的代码变得更加优雅、安全和专业。本文将从问题分析开始,通过丰富的代码实战,让你完全掌握这个强大的Python特性。

🔍 问题分析:为什么需要上下文管理器?

传统资源管理的痛点

在Python开发中,我们经常需要处理各种资源:文件、网络连接、数据库连接、线程锁等。传统的处理方式往往是这样的:

Python# 传统文件操作方式

def read_file_old_way():

file = open('data.txt', 'r')

content = file.read()

file.close() # 容易忘记关闭

return content

# 数据库连接传统方式

def query_database_old_way():

conn = sqlite3.connect('database.db')

cursor = conn.cursor()

cursor.execute('SELECT * FROM users')

result = cursor.fetchall()

cursor.close() # 可能忘记关闭

conn.close() # 可能忘记关闭

return result

这种方式存在三个主要问题:

- 容易忘记释放资源:开发者需要手动记住在适当的地方关闭资源

- 异常处理复杂:如果中间发生异常,资源可能无法正确释放

- 代码重复冗余:每次都要写相同的资源获取和释放逻辑

在Python开发过程中,你是否遇到过这样的困扰:程序出错时,只看到一个冷冰冰的Exception,无法快速定位问题?或者在团队协作中,异常信息表达不够清晰,导致调试效率低下?

自定义异常正是解决这些问题的利器! 通过创建专属的异常类,我们不仅能让错误信息更加精确、友好,还能大幅提升代码的可读性和维护性。无论你是Python新手还是有经验的开发者,掌握自定义异常都是提升编程水平的重要一步。

本文将从实际应用场景出发,详细讲解Python自定义异常的设计思路、实现方法和最佳实践,帮你写出更专业、更健壮的Python代码。

🤔 为什么需要自定义异常?

问题分析:内置异常的局限性

Python内置了丰富的异常类型,如ValueError、TypeError、FileNotFoundError等。但在实际开发中,特别是复杂的业务系统中,这些通用异常往往无法准确表达具体的业务错误。

看一个实际例子:

Pythondef transfer_money(from_account, to_account, amount):

if amount <= 0:

raise ValueError("金额必须大于0")

if from_account.balance < amount:

raise ValueError("余额不足")

if to_account.is_frozen:

raise ValueError("目标账户已冻结")

上面的代码看似正常,但存在一个严重问题:所有业务异常都是**ValueError****,调用者无法区分具体的错误类型**,只能通过解析错误信息来判断,这种做法既不优雅也不可靠。

自定义异常的优势

- 🎯 精确的错误分类:每种异常对应特定的业务场景

- 🔧 更好的异常处理:可以针对不同异常类型采用不同的处理策略

- 📖 提升代码可读性:异常名称即文档,一目了然

- 🛠️ 便于调试维护:快速定位问题根源

作为一名Windows下的Python开发者,你是否遇到过这样的情况:程序运行得好好的,突然就崩溃了?用户点击一个按钮,程序直接闪退?文件读取失败,整个应用卡死?这些问题的根源往往在于缺乏合适的异常处理机制。

今天我们就来深入探讨Python的异常处理机制(try/except/finally),帮你构建更加健壮、用户友好的Windows桌面应用程序。无论你是做数据处理、GUI开发还是上位机开发,掌握这套机制都将让你的Python开发水平上一个台阶。

🔍 问题分析:为什么需要异常处理?

💥 常见的"程序崩溃"场景

在实际的Python开发中,以下情况经常导致程序异常终止:

Python# 场景1:文件操作失败

def read_config():

file = open('config.txt', 'r') # 如果文件不存在,直接崩溃

content = file.read()

return content

Python# 场景2:数据类型错误

def calculate_average(numbers):

return sum(numbers) / len(numbers) # 如果numbers为空列表,除零错误

Python# 场景3:网络请求超时

import requests

def get_data():

response = requests.get('http://api.example.com/data') # 网络异常直接崩溃

return response.json()

这些代码在理想情况下运行良好,但一旦遇到异常情况,程序就会抛出错误并终止,用户体验极差。

在日常的Python开发中,处理CSV(逗号分隔值)文件是一个非常常见的需求。无论是数据分析、报表生成,还是系统间数据交换,CSV格式都扮演着重要角色。很多开发者可能会选择pandas等第三方库,但其实Python内置的csv模块就能满足大部分需求,而且更加轻量、高效。

本文将从实战角度出发,详细介绍如何使用Python内置的csv模块来处理各种CSV文件操作场景,包括读取、写入、处理特殊字符等常见问题,让你轻松掌握这个实用的数据处理工具。

🔍 问题分析

在Windows环境下的Python开发中,CSV文件处理主要面临以下几个挑战:

编码问题

- Windows系统默认使用GBK编码

- CSV文件可能包含中文字符

- 不同来源的文件编码格式不统一

数据格式问题

- 字段中包含逗号、换行符等特殊字符

- 数字和字符串类型的混合处理

- 空值和缺失数据的处理

性能考虑

- 大文件的分批处理

- 内存占用优化

- 读写效率提升

💡 解决方案

Python的csv模块提供了reader、writer、DictReader、DictWriter等核心类,能够完美解决上述问题。

核心优势

- 原生支持:无需安装第三方库

- 编码友好:配合open()函数轻松处理编码

- 内存高效:逐行处理,适合大文件

- 格式灵活:支持自定义分隔符和引用符

💻 代码实战

🚀 基础读取操作

Pythonimport csv

def read_csv_basic(filename):

"""基础CSV文件读取"""

try:

with open(filename, 'r', encoding='utf-8', newline='') as file:

csv_reader = csv.reader(file)

# 读取标题行

headers = next(csv_reader)

print(f"表头: {headers}")

# 读取数据行

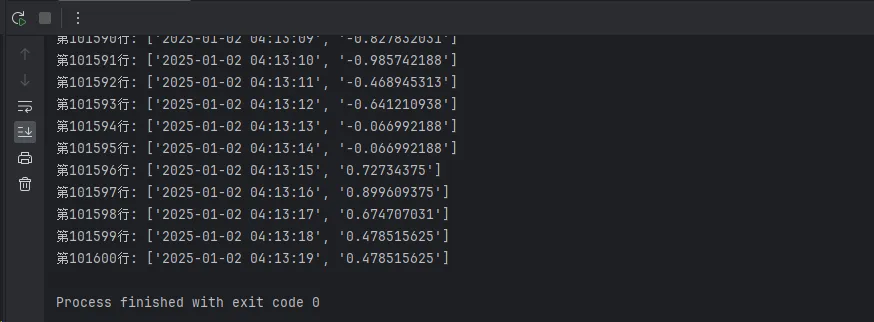

for row_num, row in enumerate(csv_reader, 1):

print(f"第{row_num}行: {row}")

except FileNotFoundError:

print(f"文件 {filename} 不存在")

except UnicodeDecodeError:

print("编码错误,尝试使用GBK编码")

# 自动尝试GBK编码

with open(filename, 'r', encoding='gbk', newline='') as file:

csv_reader = csv.reader(file)

for row in csv_reader:

print(row)

# 使用示例

read_csv_basic('振动数据.csv')

🎯 字典模式读取(推荐)

在Python开发中,特别是Windows下的上位机开发,我们经常遇到这样的场景:需要处理大量文件读写操作,但传统的同步文件操作会让程序卡顿,用户体验极差。想象一下,当你的程序需要同时处理几百个日志文件或数据文件时,如果使用传统的open()函数,程序就像老牛拉车一样慢。

今天我们就来解决这个痛点!本文将带你深入了解Python的aiofiles库,这个异步文件操作的神器能让你的程序性能提升数倍,彻底告别文件操作卡顿的烦恼。无论你是Python初学者还是有经验的开发者,都能从中获得实用的编程技巧。

🔍 问题分析:为什么需要异步文件操作?

传统同步IO的痛点

在Windows环境下进行Python开发时,我们经常遇到以下问题:

- 阻塞式操作:传统的文件读写会阻塞整个程序

- 资源浪费:CPU在等待磁盘IO时处于空闲状态

- 用户体验差:界面卡死,用户无法进行其他操作

让我们看一个典型的同步文件操作场景:

Pythonimport time

import os

def sync_file_operations():

"""传统同步文件操作示例"""

start_time = time.time()

# 模拟处理多个文件

for i in range(10):

filename = f"data_{i}.txt"

# 写入文件

with open(filename, 'w', encoding='utf-8') as f:

f.write(f"这是第{i}个文件的内容\n" * 1000)

# 读取文件

with open(filename, 'r', encoding='utf-8') as f:

content = f.read()

# 删除文件

os.remove(filename)

end_time = time.time()

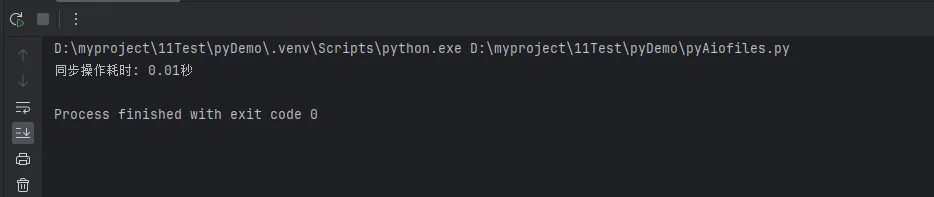

print(f"同步操作耗时: {end_time - start_time:.2f}秒")

# 运行测试

sync_file_operations()

这种方式的问题是显而易见的:每个文件操作都必须等待前一个操作完成,整个程序被串行化了。

这种方式的问题是显而易见的:每个文件操作都必须等待前一个操作完成,整个程序被串行化了。